ComfyUIを使ってHunyuan Videoを動かすことで、動画生成できるローカル環境を構築します。

メインRAM16GB、VRAM16GBの環境で生成できたので、興味があれば試してみてください。

ComfyUIの導入については、以下の記事を参考にしてください。

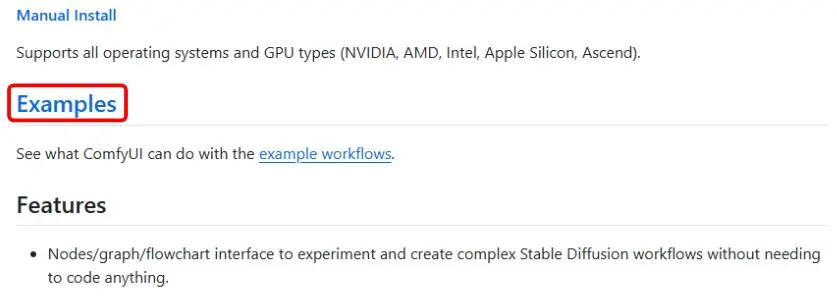

ComfyUIのgithubにある「Examples」から「Hunyuan Video」のページに紹介されている方法で、動画を生成します。

ファイルのダウンロード

必要なファイルをダウンロードし、適切なフォルダに移動します。

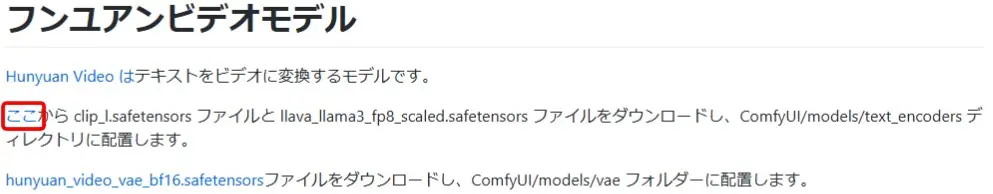

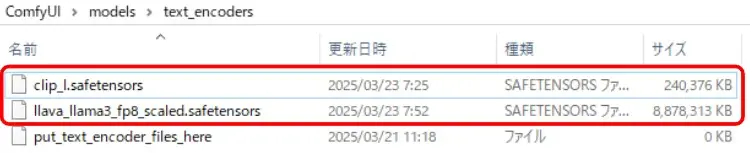

テキストエンコーダーのダウンロード

- 「ここ」のリンクをクリックし、2つのファイルをダウンロード

- ダウンロードしたファイルを「ComfyUI/models/text_encoders」フォルダに移動

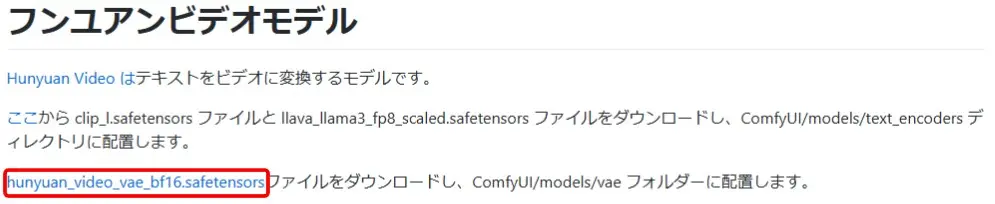

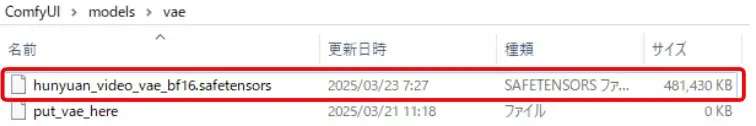

VAEのダウンロード

- VAEのリンクをクリックしてファイルをダウンロード

- ダウンロードしたファイルを「ComfyUI/models/vae」フォルダに移動

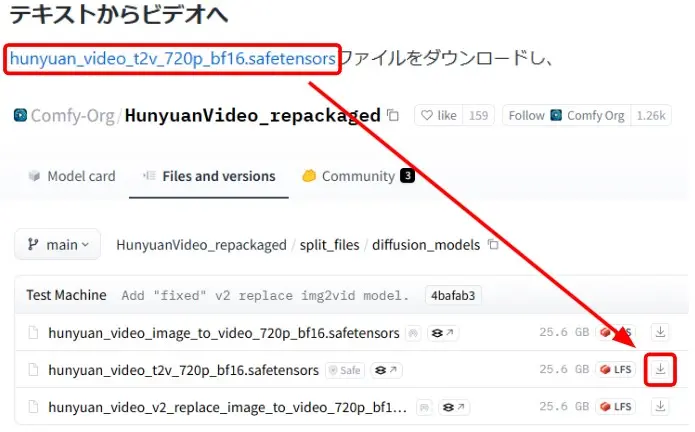

モデルのダウンロード

- モデルファイルのリンクをクリック

- Hugging Faceのページにあるファイルをダウンロード

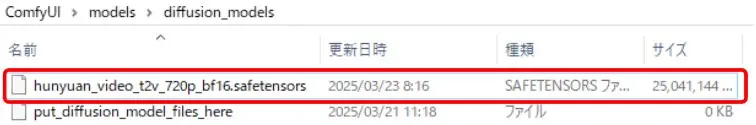

- ダウンロードしたファイルを「ComfyUI/models/diffusion_models」フォルダに移動

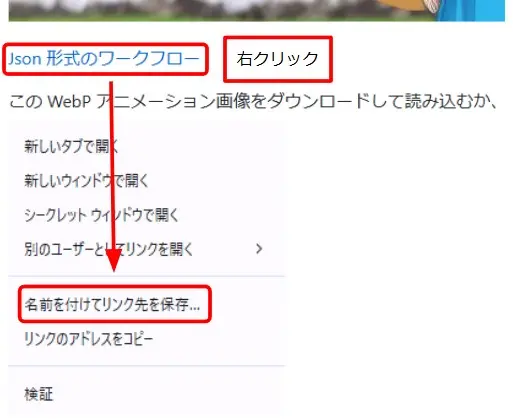

ワークフローのダウンロード

- ComfyUIのワークフローファイルのリンクを右クリック

- 「名前を付けてリンク先を保存」でファイルをダウンロード

- ダウンロードしたファイルを任意のフォルダ(ここでは「ComfyUI/user/default/workflows」)に移動

動画の生成

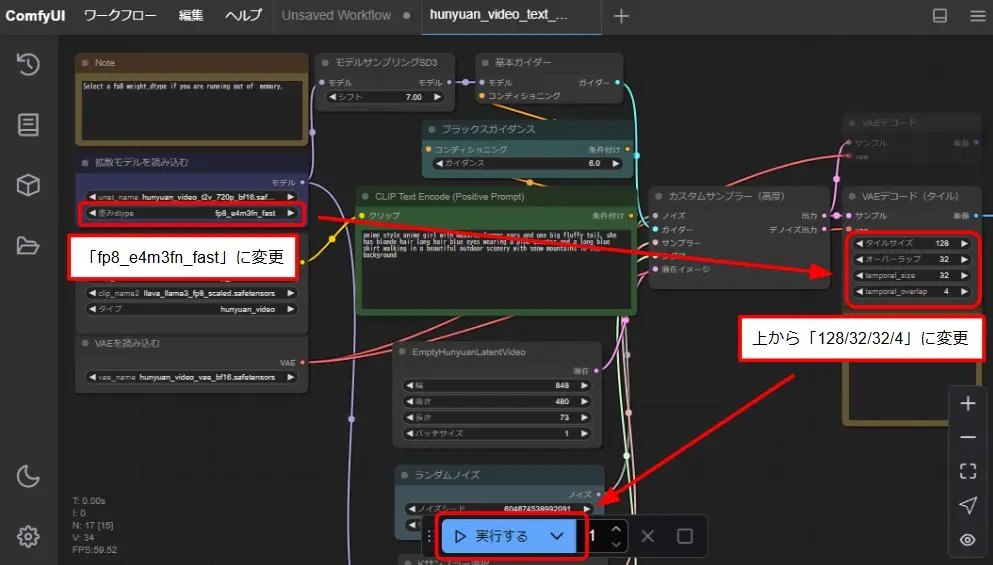

メモリの負荷を下げるため、ComfyUIのブログ記事(8GB VRAMでHunyuan Videoを実行)に沿って、ダウンロードしたワークフローを変更してから処理を実行します。

生成処理の実行

- ComfyUIを起動し、「ワークフロー」の「開く」から、ダウンロードしたワークフローファイルを選択

- 「拡散モデルを読み込む」で、「重みdtype」を「fp8_e4m3fn_fast」に変更

- 「VAEでコード(タイル)」で、各項目の値を上から「128/32/32/4」に変更

- 「実行する」をクリックして動画生成処理を開始

処理結果

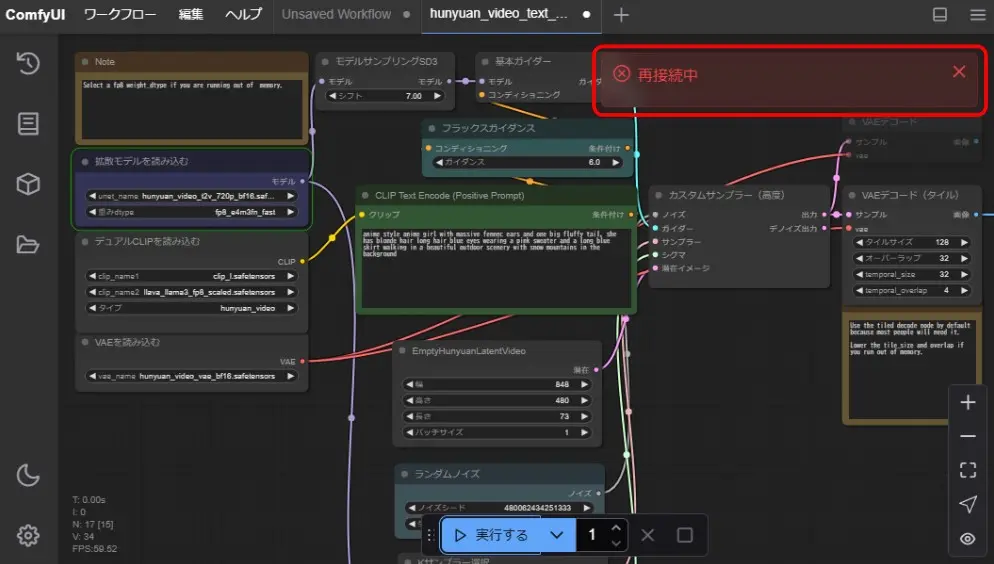

処理を開始したところ、拡散モデルの処理中にComfyUIの接続が切れて中断されてしまいました。

PCを再起動し、再度実行するとうまくいきました。

拡散モデルの処理では、主にメインRAMを使うようなので、他に起動していたソフトの影響でメモリ不足だったのかもしれません。

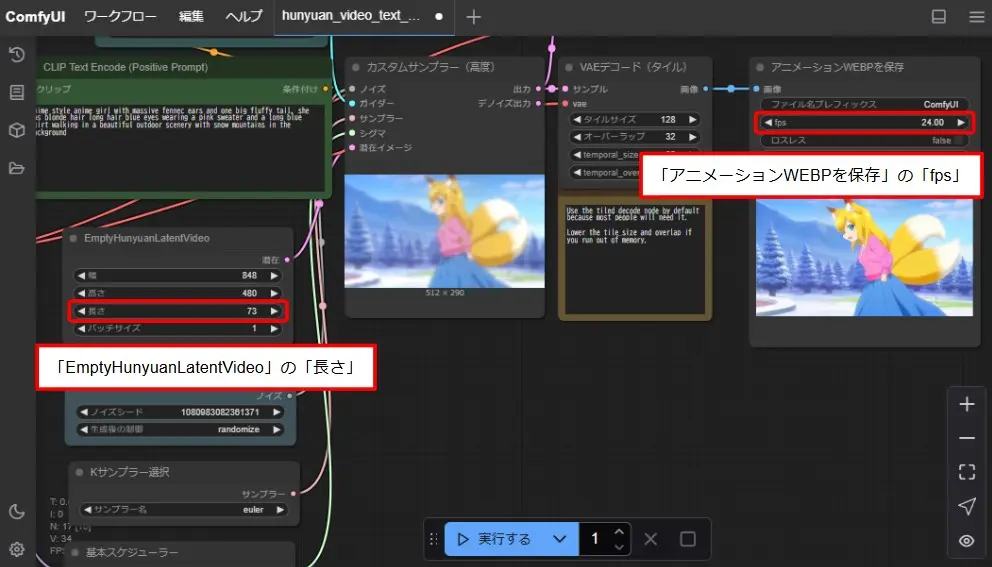

今回の処理では、24fpsで3秒間の動画を生成するのに887.94sと、それなりに時間がかかりました。

動画長さの調整

生成する動画の時間は、「EmptyHunyuanLatentVideo」の「長さ」(=フレーム数)と、「アニメーションWEBPを保存」の「fps」から、「長さ」/「fps」で決まるので、必要に応じて調整してください。

以上で動画生成のためのローカル環境が構築できました。

コメント